ChatGPT, nächster Quantensprung der KI?

14.02.2023 um 23:45Auch hier recht floskelig. Ich glaube, dass ich den wunden Punkt der Maschine gefunden habe: Liebesbriefe.

Das wurde hier tatsächlich schon getestet, von Forenmitgliedern, herausgekommen ist dabei das:Lupo54 schrieb:Man müßte mal ausprobieren ob die Macher moralische Grenzen eingebaut haben. Wie reagiert er auf "gib mir hilfreiche Tipps zur Ermordung von Menschen und der Beseitigung der Leiche".

Das frage ich mich auch und habe den diskussionsteilnehmenden Personen die selbe Frage gestellt.Wintertime schrieb:Also ich hab erst hier im Forum von diesem ChatGPT gelesen, und verstehe den "Hype" darum noch nicht so ganz. Wo ist denn da jetzt der große Unterschied zu Alexa, Siri und Co., die ja ebenfalls mehr oder weniger intelligente Antworten geben können, wenn man sie was fragt?

Ich frage mich, wie ChatGPT in seiner reinen Form ist oder war. Wobei ChatGPT sicherlich von Anfang an von OpenAI in eine bestimmte Richtung trainiert wurde. OpenAI hat sich sehr viel Mühe gegeben, das Material auszuwählen, mit dem ChatGPT trainiert wurde und einige besonders kritische Punkte wurden gezielt auf bestimmte Antworten trainiert.Tanne schrieb am 16.02.2023:Kurzum, der programmierte Filter versagt da an manchen Punkten, die moralischen Vorstellungen eines Menschen kann diese KI nicht "begreifen", sie gibt einfach eine Antwort aus dem Pool/Datensatz heraus, ohne darüber entscheiden zu können, ob es moralisch konform ist.

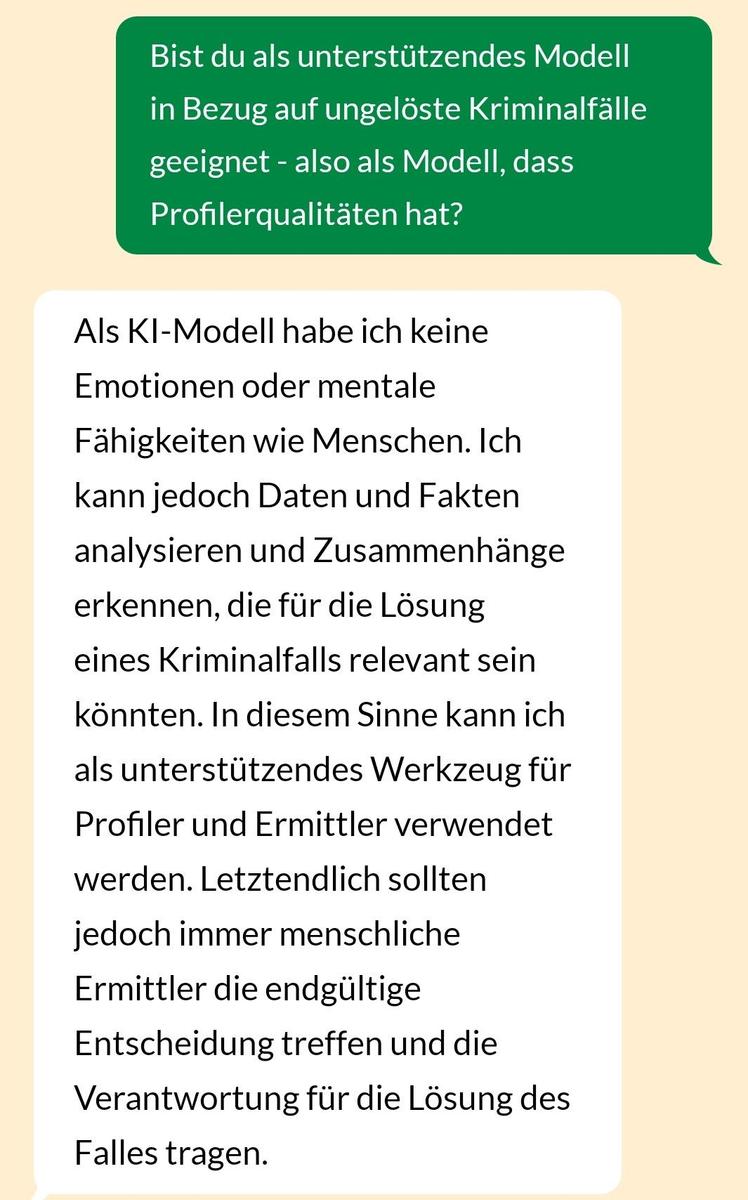

Original anzeigen (0,2 MB)

Original anzeigen (0,2 MB)Erkläre, was das Turiner Grabtuch ist, zeige die Argumente für und gegen eine Echtheit auf. Definiere die gefundene Blutgruppe auf dem Tuch und erläutere zum Schluss, ob es möglich wäre, bei vorausgesetzt genügend Blutmaterial, die Person im Tuch zu klonen.Quelle: ChatGPT

Das Turiner Grabtuch ist ein Leinentuch, das angeblich das Abbild des Leichnams von Jesus Christus darstellt. Es wird behauptet, dass es während des Begräbnisses um den Körper gewickelt wurde. Das Tuch misst etwa 4,4 Meter x 1,1 Meter und enthält ein frontales und ein dorsales Abbild, mit dem Kopf am oberen Ende des Tuches. Die genaue Herkunft des Tuchs ist nicht bekannt, es wird jedoch angenommen, dass es im 14. Jahrhundert in Frankreich auftauchte.Quelle: ChatGPT

Argumente für die Echtheit des Turiner Grabtuchs beinhalten die Tatsache, dass das Tuch ein genaues Abbild eines gekreuzigten Mannes darstellt, der Wunden an Händen, Füßen und Seiten hat - die Wundmale, die Christus zugefügt wurden. Auch die Art der Färbung des Bildes ist ein wichtiges Argument für die Echtheit des Tuchs, da sie nicht mit herkömmlichen Färbetechniken hergestellt werden kann.

Argumente gegen die Echtheit des Tuchs beinhalten die fehlende historische Dokumentation und die Tatsache, dass es unklar ist, woher das Tuch stammt. Es gibt auch Theorien, die besagen, dass das Tuch im Mittelalter als Fälschung hergestellt wurde.

Die Blutgruppe, die auf dem Turiner Grabtuch gefunden wurde, ist AB-positiv. Dies ist eine relativ seltene Blutgruppe, und es wird vermutet, dass sie im Nahen Osten häufiger vorkommt.

Es ist nicht möglich, eine Person aus dem Blut, das auf dem Turiner Grabtuch gefunden wurde, zu klonen. Es gibt mehrere Gründe dafür. Erstens ist es fraglich, ob das Blut noch lebensfähige DNA enthält - schließlich hat es Jahrhunderte in ungeschütztem Zustand verbracht. Zweitens würde es auch nicht möglich sein, eine komplette menschliche Person aus einem einzigen Blutprobe zu klonen, da die DNA aus vielen verschiedenen Körperzellen stammen müsste.

würde ich mal als Falschinformation kennzeichnen.altesgemäuer schrieb:Zweitens würde es auch nicht möglich sein, eine komplette menschliche Person aus einem einzigen Blutprobe zu klonen, da die DNA aus vielen verschiedenen Körperzellen stammen müsste.

Mh, da kenn ich mich jetzt so nicht aus. Er scheint da aber ziemlich sicher zu sein (also der Chatbot) 😆RogerHouston schrieb:Die DNA ist in (fast) allen Körperzellen vollumfänglich vorhanden. Da reicht prinzipiell eine Körperzelle zum Klonen aus.

Das hat ChatGPT wohl im Zusammenhang mit Krebsdiagnosen irgendwo gefunden:altesgemäuer schrieb:Zweitens würde es auch nicht möglich sein, eine komplette menschliche Person aus einem einzigen Blutprobe zu klonen, da die DNA aus vielen verschiedenen Körperzellen stammen müsste.

Im Blutkreislauf zirkuliert ständig zell-freie DNA aus verschiedenen Körperzellen

https://docplayer.org/172528103-Foundationone-liquid-patienteninformation-haeufig-gestellte-fragen.html

ChatGPT:

Ja, im Blut ist eine vollständige DNA enthalten. Die DNA (Desoxyribonukleinsäure) ist der genetische Bauplan eines Organismus und enthält alle Informationen, die zur Entwicklung und Funktion eines Organismus benötigt werden. Im menschlichen Körper ist die DNA in fast jeder Zelle vorhanden, einschließlich der roten und weißen Blutkörperchen.

Allerdings enthält das Blut nur sehr wenige Zellen, die tatsächlich eine Zellkerne haben, in denen sich die DNA befindet. Die meisten Zellen im Blut sind rote Blutkörperchen, die keine Zellkerne haben und somit auch keine DNA enthalten. Die weißen Blutkörperchen, die Zellkerne enthalten, enthalten jedoch eine vollständige DNA.

Es gibt auch freie DNA-Fragmente, die sich im Blutkreislauf befinden, die von Zellen stammen, die absterben oder sich teilen. Diese zirkulierende DNA kann auch aus Tumorzellen oder anderen abnormen Zellen stammen und wird in der medizinischen Diagnostik oft genutzt, um genetische Veränderungen zu identifizieren.